大语言模型的规模增长面临算力与存储的双重约束。如何在保持模型能力的前提下降低推理成本,已成为工业落地的核心命题。MoE(混合专家模型)、稀疏参数与知识蒸馏三项技术从不同维度破解这一困境:MoE通过动态激活部分参数实现稀疏化,稀疏参数释放了规模化的潜力,知识蒸馏则将大模型能力迁移至小模型。三者协同,代表了大模型从”大而强”走向”大而轻”的主流技术路径。

MoE:稀疏激活的神经网络架构

MoE的核心思想是”分而治之”。传统神经网络对所有输入执行相同的计算路径,而MoE将模型分解为多个并行的专家网络(Expert Networks),由一个门控网络(Gating Network)根据输入内容动态选择激活哪些专家。

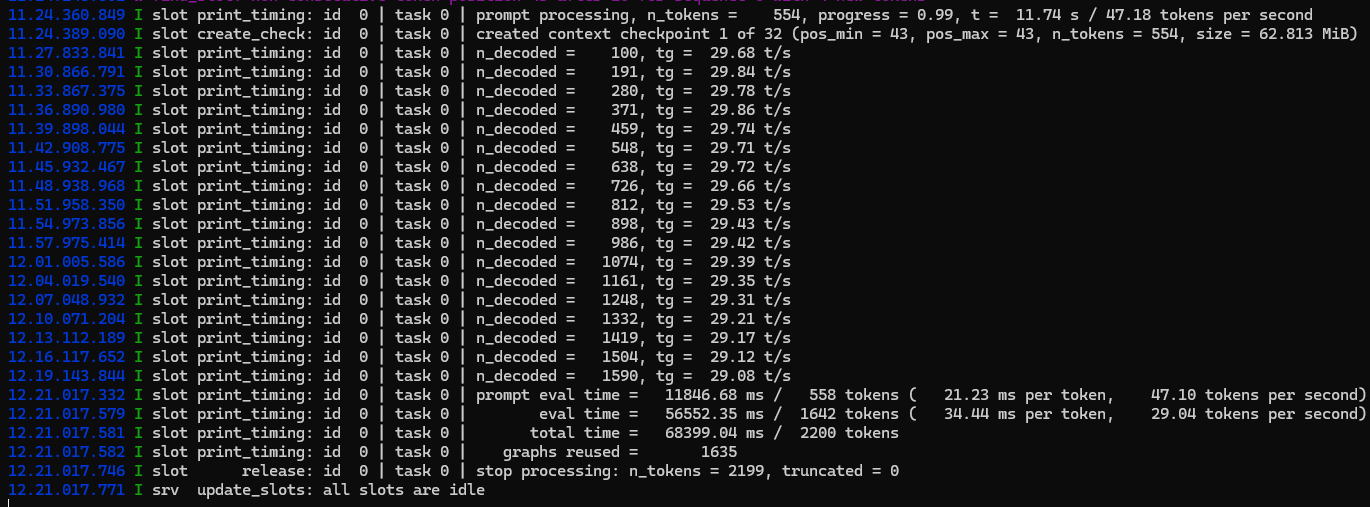

具体而言,门控网络为每个输入token输出一组权重分布,决定各专家的参与程度。推理时,只有权重较高的少数专家被实际调用,其余专家的计算被跳过。以DeepSeek-R1-671B为例,其总参数规模为671B,但推理时每次仅激活约1/10的专家,单步计算量等价于一个67B的稠密模型。这意味着模型在拥有超大规模参数的同时,将实际计算成本控制在远低于总参数的量级。

MoE的优势在于:相同算力预算下可以容纳更多参数,从而突破稠密模型的规模瓶颈;不同专家可专注于不同类型的任务或知识领域,实现隐式的专业化分工。

稀疏参数:规模与效率的重新平衡

稀疏参数并非MoE独有,但MoE是其最典型的工程实现。稀疏的含义是:总参数量巨大,但任意时刻只有部分参数被实际使用。

这一特性带来三方面价值。首先是规模突破:在相同的算力和显存约束下,稀疏模型可以拥有10-100倍于稠密模型的参数量,因为大部分参数无需同时参与计算。其次是推理成本降低:激活参数少意味着每次前向传播的FLOPs大幅减少,部署成本随之下降。第三是专业化分工:不同专家可学习不同领域的知识,形成隐式的任务路由,避免单一模型试图同时掌握所有能力导致的表达冲突。

稀疏参数的本质是用”参数冗余”换取”计算高效”——存储的是大规模知识,执行时只调用与当前输入相关的部分。

知识蒸馏:从大模型到小模型的能力迁移

知识蒸馏(Knowledge Distillation)是将大模型(教师模型)能力迁移至小模型(学生模型)的技术。其核心机制是让小模型不仅学习硬标签(真实标签),还学习软标签(教师模型输出的概率分布)。

软标签包含的信息远多于硬标签。硬标签只告诉模型”正确答案是什么”,而软标签还携带了”错误答案之间的相对关系”——模型认为”猫”和”狗”的相似度高于”猫”和”汽车”,这种隐含的相似结构正是知识蒸馏希望传递的”暗知识”。

以DeepSeek-R1-Distill系列为例,教师模型为DeepSeek-R1-671B(MoE架构),学生模型则包括Qwen系(1.5B/7B/14B/32B)和Llama系(8B/70B)等多个规模的稠密模型。蒸馏后的小模型在保持极小参数量的同时,复现了教师模型在推理任务上的核心能力。

三者协同:技术飞轮的运转逻辑

三项技术的协同构建了一个高效的技术飞轮。

MoE提供了”超强教师”的可能——凭借稀疏激活,MoE模型可以在总参数极大的同时保持推理效率,这意味着教师模型可以拥有前所未有的知识容量和多样性。知识蒸馏则充当”能力搬运工”,将教师从海量参数中习得的知识以软标签的形式传递给轻量的学生模型。稀疏参数是连接两者的桥梁——它既是MoE的实现基础,也是蒸馏得以可行的前提,因为只有稀疏架构才能在保持大规模知识的同时具备足够的推理效率来完成蒸馏过程。

最终实现的效果是”高性能+低成本”的落地:教师模型负责知识生产和能力探索,学生模型负责实际部署和服务。这种分工在保持能力上限的同时,大幅降低了端侧部署的门槛。

总结

MoE通过稀疏激活打破了”参数量=计算量”的等式约束,为大规模模型的训练提供了新的可行路径。稀疏参数将这一优势工程化,实现规模与效率的重新平衡。知识蒸馏则在不损失核心能力的前提下,将大模型的优势迁移到可部署的轻量模型。三项技术共同推动了大模型从”大而强”向”大而轻”的关键演进,为AI能力的广泛落地扫清了算力壁垒。